Lesezeit 13 Min |  Autorin Michèle Oßowski

Autorin Michèle Oßowski

Im Mai 2025 hat Google die nächste Stufe der KI-Revolution gezündet: Der AI Mode wird großflächig ausgerollt, die Suche wird proaktiver, visueller – und deutlich interaktiver. Mit neuen Funktionen wie Product Cards, dem History Panel und tief integrierten Ads verändert sich nicht nur das Nutzerverhalten, sondern auch die Spielregeln für Sichtbarkeit in der Suche.

Was bedeuten diese Entwicklungen für SEO-Strategien? Wie lassen sich Inhalte für AI Overviews optimieren? Und welche Chancen bietet das erweiterte Gemini-Ökosystem mit Tools wie Deep Research, Imagen 4 oder Gemini Live? Wir haben die wichtigsten Trends, Funktionen und Empfehlungen aus dem Mai für euch aufbereitet – fundiert, verständlich und praxisnah. Jetzt durchstarten und Suchergebnisse neu denken!

Inhalt

PageSpeed Insights wird künftig „Diagnose“ durch „Insights“ ersetzen

Hast du letztens mal deine PageSpeed Insights geprüft? Dann wird dir vielleicht der kleine Hinweiskasten aufgefallen sein, dass es in Google PageSpeed Insights eine Veränderung geben wird. Der Leistungsbericht wird im Laufe des Jahres mit „Insights“ ersetzt.

Hintergrund der Änderung ist die Ankündigung von Google Chrome, die eigenen Leistungstools zu verbessern und anzugleichen. Darunter auch Tools wie Lighthouse oder die Chrome DevTools. Das Ziel: Alle Tools, welche Auskunft über Performance geben sollen die gleichen Empfehlungen bieten.

Bereits jetzt kann man zwischen der „Diagnose“ und den „Insights“ hin- und herwechseln. Die Unterschiede liegen hier im Detail: Die Ansicht bleibt nahezu gleich, allerdings unterscheiden sich die Hinweise, wie ihr eure Core Web Vitals optimieren könnt.

Quellen: Chrome Developers, Dominik Graser LinkedIn

OpenAI gibt Insights in Rankingfaktoren für Produkte in ChatGPT

Im April wurde bekannt, dass Google innerhalb der AI Overviews verstärkt auf eigene Suchergebnisseiten verlinkt. Während AI Overviews zuvor meist auf externe Quellen wie Wikipedia oder Nachrichtenseiten verwiesen, erscheinen nun häufiger Links, die lediglich zu weiteren Google-Suchergebnissen führen. Ziel laut Google: Den Nutzern einen einfacheren Zugang zu verwandten Informationen bieten.

Kritiker sehen darin jedoch eine Bevorzugung eigener Inhalte und befürchten negative Auswirkungen auf den organischen Traffic externer Websites. Auch Fragen zur Transparenz werden laut, da viele Nutzer interne Suchergebnisse möglicherweise nicht als solche erkennen.

Wie wählt ChatGPT Produkte aus?

- Nutzerintention und Kontext

ChatGPT analysiert die Anfrage des Nutzers sowie vorhandene Kontextinformationen, wie frühere Interaktionen oder benutzerdefinierte Anweisungen, um relevante Produkte vorzuschlagen. Beispielsweise wird bei einer Anfrage wie „Ich suche nach lustigen Kostümen für meine zwei großen Hunde“ nicht nur die Produktkategorie berücksichtigt, sondern auch spezifische Präferenzen, etwa die Größe der Hunde oder der gewünschte Stil des Kostüms.

- Strukturierte Daten und Drittanbieterinhalte

Die Produktempfehlungen stützen sich auf strukturierte Metadaten von Drittanbietern, wie Preisangaben und Produktbeschreibungen, sowie auf weitere Inhalte wie Kundenbewertungen. Diese Informationen helfen ChatGPT, relevante Produkte zu identifizieren und dem Nutzer vorzustellen.

- Produktdarstellung und Zusatzinformationen

- Vereinfachte Produktbeschreibungen: Um die Lesbarkeit zu verbessern, generiert ChatGPT vereinfachte Titel und Beschreibungen basierend auf den verfügbaren Daten.

- Feature-Labels: Einige Produktbilder können Labels wie „Preiswert“ oder „Am beliebtesten“ enthalten, die von ChatGPT basierend auf den verfügbaren Informationen erstellt werden.

- Bewertungszusammenfassungen: ChatGPT kann Zusammenfassungen von Produktbewertungen anzeigen, die häufig genannte Vor- und Nachteile hervorheben.

- Sternebewertungen: Einige Produkte zeigen Sternebewertungen und die Anzahl der Bewertungen an, die von Drittanbietern bereitgestellt werden. Diese aggregierten Bewertungen müssen nicht mit denen auf spezifischen Websites übereinstimmen.

- Preisangaben und Händlerinformationen

Die angezeigten Preise stammen von Drittanbietern und spiegeln in der Regel den Preis des zuerst aufgeführten Händlers wider, was nicht unbedingt der niedrigste verfügbare Preis ist. Wenn ein Nutzer auf ein Produkt klickt, kann ChatGPT eine Liste von Händlern anzeigen, die es anbieten. Diese Liste wird basierend auf Händler- und Produktmetadaten erstellt, die von Drittanbietern stammen. Die Reihenfolge, in der Händler angezeigt werden, wird hauptsächlich von diesen Drittanbietern bestimmt. ChatGPT nimmt keine Neusortierung basierend auf Faktoren wie Preis, Versand oder Rückgaberichtlinien vor.

AI Overview für mehr Nutzer verfügbar

Google hat angekündigt, die AI Overviews in weiteren Sprachen und Ländern auszurollen. Damit ist die „neue Art der Suche“ nun in mehr als 200 Ländern verfügbar und unterstützt über 40 Sprachen – darunter zum Beispiel auch Chinesisch, Urdu oder Arabisch. Google äußert sich in der Kundgebung wie folgt zum Erfolg der AI Overviews:

As people use AI Overviews, we see they’re happier with their results, and they search more often. In our biggest markets like the US and India, AI Overviews is driving over 10% increase in usage of Google for the types of queries that show AI Overviews. This means that once people use AI Overviews, they are coming to do more of these types of queries, and what’s particularly exciting is how this growth increases over time. And we’re continuing to bring new advancements – starting this week, we’re bringing a custom version of Gemini 2.5, our most intelligent model, to AI Overviews in the U.S. so Search can tackle even harder questions.

We look forward to helping people search more effortlessly, in more places around the world.

Zitat: Google

Quelle: Google Blog

Weitere Updates für Googles Gemini 2.5

Zeitgleich mit der Ankünding, dass die AI Overviews in weiteren Ländern verfügbar gemacht werden sollen, gab Google bekannt, ein weiteres Update für sein KI-Modell Gemini 2.5 zu veröffentlichen. Die herausragende Neuerung ist der experimentelle Modus „Deep Think“. Dieser ermöglicht es Gemini 2.5 Pro, mehrere Hypothesen zu prüfen, bevor eine Antwort generiert wird. Dadurch kann das Modell hochkomplexe Aufgaben in Mathematik und Programmierung besser lösen.

Das neue Modell Gemini 2.5 Flash ist bereits in der Gemini-App verfügbar. Die aktualisierte Version wird Anfang Juni in Google AI Studio für Entwickler und in Vertex AI für Unternehmen allgemein zugänglich sein. 2.5 Pro folgt kurz darauf.

Quelle: Google Blog

Gemini App wird persönlicher, proaktiver und leistungsstärker

Mit den jüngsten Updates zur Google I/O 2025 erhält die Gemini-App ein umfassendes Funktions-Upgrade und kommt der Vision eines intelligenten, alltagstauglichen Assistenten damit noch näher.

- Besonders hervorzuheben ist Gemini Live, eine neue Funktion, die Kamera- und Bildschirmfreigaben in Echtzeit ermöglicht. Nutzer können der KI Inhalte zeigen, um darauf basierende Antworten, Analysen oder Empfehlungen zu erhalten – sei es beim Navigieren durch eine App oder beim Lösen komplexer Aufgaben auf dem Bildschirm.

- Parallel dazu wurde mit Veo 3 ein neues Videomodell vorgestellt, das realistische, detailreiche Videos mit Ton generieren kann. Dadurch eröffnen sich neue Ausdrucksformen für kreative und redaktionelle Arbeit – etwa beim Erstellen von Produktpräsentationen oder Storyboards. Auch die Bildgenerierung wurde aktualisiert: Imagen 4 liefert deutlich realistischere und stilistisch vielseitigere Ergebnisse und positioniert sich damit als ernstzunehmende Alternative zu bestehenden Visual-Tools.

- Für den professionellen Einsatz besonders spannend: Mit Deep Research steht ab sofort ein leistungsfähiger Recherchemodus zur Verfügung, der strukturierte, quellengestützte Antworten Er eignet sich ideal für die Vorbereitung fundierter SEO- oder Content-Kampagnen.

- Zudem wird Gemini tiefer in den Alltag integriert, beispielsweise durch eine direkte Anbindung an Google Chrome, die eine kontextbezogene Unterstützung beim Browsen ermöglicht. So entwickelt sich die App immer mehr zu einem persönlichen Co-Piloten, der nicht nur reagiert, sondern proaktiv mitdenkt und vorausschauend unterstützt.

Quellen: Search Engine Journal, Google Blog

Wie nutze ich das neue Gemini Modell für meine SEO?

Mit dem neuen Gemini-Modell von Google eröffnen sich spannende Möglichkeiten für die tägliche SEO-Arbeit – insbesondere bei der Recherche, der Content-Optimierung und der Analyse von Nutzerintentionen. Durch seine multimodalen Fähigkeiten kann Gemini nicht nur Texte verarbeiten, sondern auch mit Bildern, Code und Tabellen umgehen, was die Einsatzbereiche deutlich erweitert.

SEO-Profis profitieren unter anderem bei der Keyword-Analyse, bei der Formulierung semantisch vielfältiger Inhalte sowie bei der Strukturierung komplexer Themen. Auch die Erstellung von Snippet-optimierten Textpassagen, FAQ-Blöcken oder Meta-Beschreibungen lässt sich mit Gemini effizient umsetzen. Besonders hilfreich ist das Modell zudem bei der Generierung von Content-Ideen und beim Vergleich mit Wettbewerbsinhalten.

Wichtig ist, Gemini nicht einfach als reines Textwerkzeug zu nutzen, sondern gezielt mit strategischen Prompts zu arbeiten – etwa um Nutzerfragen aus verschiedenen Blickwinkeln zu beleuchten oder Inhalte besser auf E-E-A-T-Kriterien (Experience, Expertise, Authoritativeness, Trustworthiness) auszurichten.

Quelle: Search Engine Land

Key Takeaways der Google I/O

Die Google I/O 2025 stand ganz im Zeichen der Künstlichen Intelligenz, die in nahezu allen Bereichen von Suche bis Produktivität neue Maßstäbe setzt. In der Keynote wurde eindrucksvoll gezeigt, wie Google mit seinen neuesten Entwicklungen eine noch engere Verzahnung von KI, Alltag und Arbeit schafft – und damit das digitale Erlebnis grundlegend verändert.

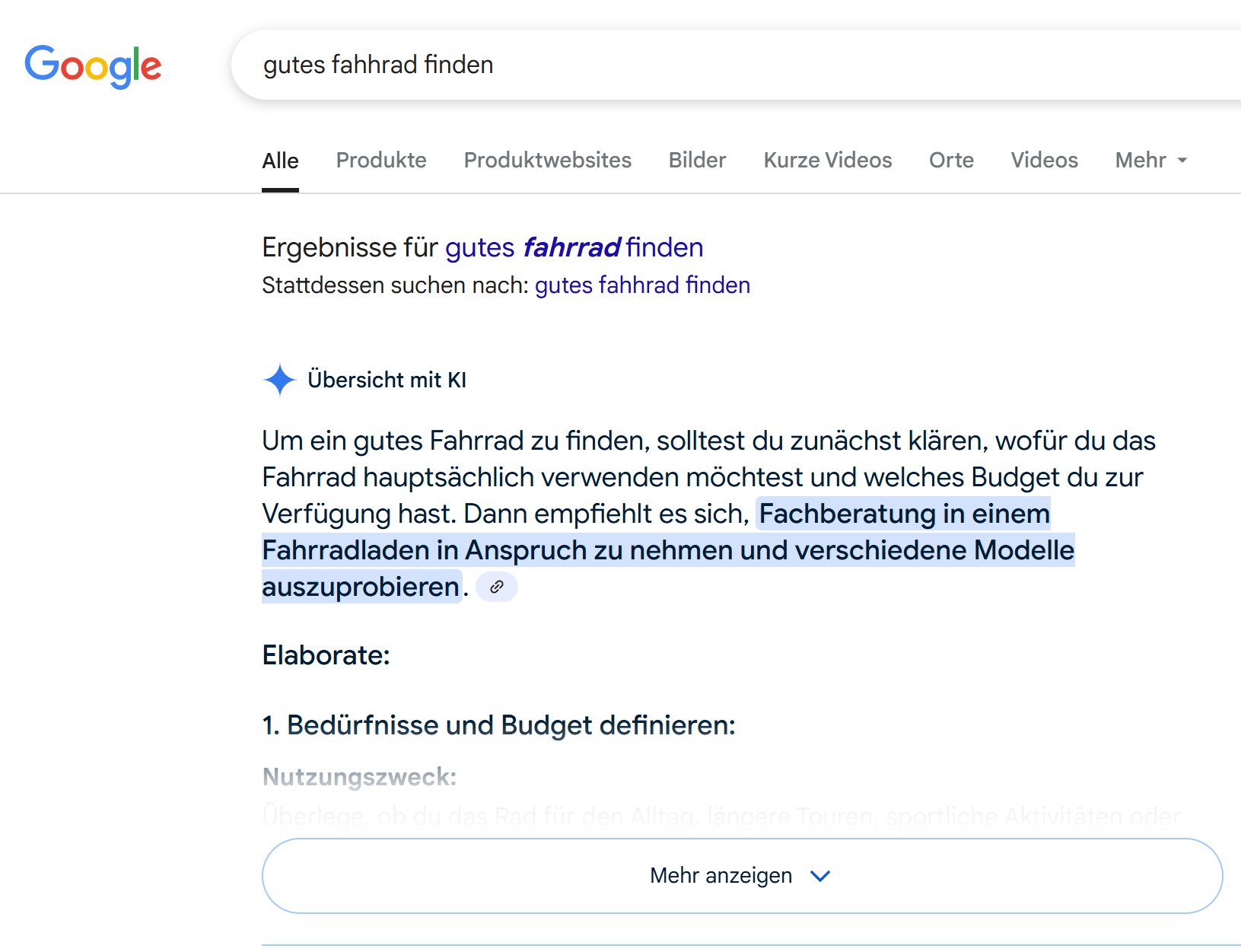

AI Overviews: Intelligente Suchergebnisse

Die AI Overviews, die in der Keynote als „next generation of search“ bezeichnet wurden, bringen generative KI direkt in die Google-Suche. Nutzer erhalten kompakte, präzise Antworten auf komplexe Fragen – angereichert mit weiterführenden Links und Kontext. Google zeigte in der Präsentation, wie diese Funktion die Suche vereinfachen und gleichzeitig für Content-Ersteller neue Herausforderungen und Chancen schafft, indem Inhalte noch stärker auf Nutzerintention und Vertrauenswürdigkeit ausgerichtet werden müssen.

Ask Photos: Visuelle Intelligenz in Google Fotos

Ein weiterer Fokus lag auf der Integration von Gemini in Google Fotos. Die Funktion „Ask Photos“ ermöglicht es, natürliche Fragen zu Fotos zu stellen und konkrete Antworten zu bekommen, inklusive visueller Hinweise. Die Keynote hob hervor, wie diese semantische Bildsuche den Umgang mit persönlichen Daten revolutioniert und neue Nutzungsszenarien eröffnet.

KI in Workspace: Ein smarteres Arbeiten

In der Keynote wurde auch die KI-Integration in Google Workspace intensiv vorgestellt. Neben bekannten Funktionen wie automatischer Textgenerierung und Korrekturen zeigte Google neue Features, die den Schreibprozess und die Datenanalyse vereinfachen. Besonders spannend: Die KI fungiert zunehmend als aktiver Partner, der nicht nur Vorschläge macht, sondern kontextbezogen und dialogorientiert unterstützt, was den Workflow deutlich flüssiger macht.

Multimodale KI: Zukunft der Interaktion

Google betonte, dass Multimodalität die Zukunft ist. Die Fähigkeit von Gemini und anderen Modellen, Text, Bild, Video, Audio und Code gleichzeitig zu verstehen und zu verarbeiten, eröffnet völlig neue Möglichkeiten – sei es bei der Content-Erstellung, komplexen Analysen oder interaktiven Anwendungen. Die Keynote machte deutlich, dass diese Entwicklung nicht nur technologische, sondern auch inhaltliche und strategische Veränderungen mit sich bringt.

Quelle: Google Blog, Google Blog

Jetzt kostenlosen SEO Check sichern!

Einfach Ansprechpartner und URL hier einsenden

Google kündigt große Einführung des AI Mode an

Google startet die breite Einführung des AI Mode in der Suche, der das Nutzererlebnis deutlich interaktiver und personalisierter macht. Neben klassischen Suchergebnissen werden nun KI-generierte Zusammenfassungen, Empfehlungen und kreative Antworten eingeblendet, die Nutzern komplexe Fragen leichter verständlich machen.

Ein besonderes Highlight sind die Live Capabilities, mit denen die KI in Echtzeit auf Nutzeraktionen reagiert, Inhalte dynamisch nachlädt und aktiv beim Problemlösen unterstützt. So wird die Suche von einer rein reaktiven zu einer proaktiven Plattform, die Nutzer gezielt begleitet.

Der AI Mode unterstützt zudem multimodale Suchanfragen, bei denen Text, Bilder und Sprache kombiniert werden können, um noch präzisere Ergebnisse zu liefern. Die Einführung erfolgt schrittweise weltweit.

Für SEO bedeutet das, dass Inhalte künftig stärker auf kontextbezogene, dialogorientierte Nutzeranfragen ausgerichtet sein müssen, um in der neuen Suchlandschaft relevant zu bleiben.

Quelle: Google Blog

AI Mode in den USA verfügbar

Nach einer monatelangen Testphase ist der „AI Mode” ab sofort für alle Suchenden in den USA aktiviert – sowohl auf dem Desktop als auch mobil. Damit steht ein zentrales Element von Googles neuer KI-Strategie einer breiten Öffentlichkeit zur Verfügung. Der „AI Mode” ersetzt die klassische Suche nicht, sondern ergänzt sie um generative Antworten, interaktive Zusammenfassungen und weiterführende Inhalte.

Nutzer können Fragen natürlicher formulieren, auf Basis von KI-Vorschlägen weiterfragen oder sich durch komplexe Themen führen lassen – ähnlich wie in einem Gespräch. Durch die Verknüpfung mit verlässlichen Quellen bleibt die Transparenz erhalten, während die Interaktivität deutlich zunimmt.

Google kündigte zudem an, den Rollout bald auf weitere Länder und Sprachen auszuweiten. Der Start in den USA markiert somit einen wichtigen Meilenstein in der globalen Transformation der Google-Suche hin zu einem KI-gestützten Informationssystem.

Für Unternehmen, SEOs und Content-Ersteller bedeutet das: Ihre Inhalte müssen sich nicht nur gegen andere Webseiten, sondern auch gegen die Antwortlogik einer KI behaupten – sie müssen also prägnanter, strukturierter und noch stärker auf echte Nutzerfragen ausgerichtet sein.

Quelle: Google Blog

Neue Funktionen im AI Mode: Product & Place Cards sowie History Panel

Mit dem offiziellen Start des AI Mode in der Google-Suche wurden auch neue Funktionen vorgestellt, die das Nutzungserlebnis weiter aufwerten – allen voran die Product Cards, Place Cards und das neue History Panel.

Die Product Cards zeigen empfohlene Produkte direkt innerhalb der KI-generierten Antworten an – inklusive Bildern, Preisen, Bewertungen und weiterführenden Links. Besonders für E-Commerce und Produktvergleichsseiten könnte das eine neue Form der Sichtbarkeit bedeuten – oder aber eine zusätzliche Konkurrenz durch Googles eigene Inhalte.

Place Cards funktionieren ähnlich, liefern aber ortsbezogene Empfehlungen wie Restaurants, Geschäfte oder Sehenswürdigkeiten inklusive Standort, Öffnungszeiten und Nutzerbewertungen. Diese Funktion betont erneut, wie wichtig lokale Relevanz und gut gepflegte Unternehmensprofile für die Sichtbarkeit in der Suche werden.

Ergänzt wird das Ganze durch das History Panel, das Suchverläufe KI-basiert organisiert. Nutzer können darin auf frühere Anfragen, KI-Antworten und Links zugreifen und so ihre Recherche fortsetzen, ohne den roten Faden zu verlieren. Das Sucherlebnis wird dadurch nicht nur personalisierter, sondern auch nachhaltiger – weil Google gezielt Kontext aufbaut.

Diese Funktionen unterstreichen, dass der AI Mode nicht nur Antworten liefert, sondern Suchverhalten aktiv begleitet und strukturiert. Für Websitebetreiber und SEOs heißt das: Es genügt nicht mehr, nur zu ranken – Inhalte müssen auch in neuen Formaten wie Produktdaten oder Standortinfos optimal ausgespielt werden können.

Quellen: Google Blog, Google Developers

AI Mode in Search: So funktioniert die neue Google-Suche

Der AI Mode verändert nicht nur das „Wie“ der Google-Suche, sondern auch das „Was“. Im Zentrum steht eine dynamische, dialogbasierte Nutzerführung, bei der Google auf natürliche Spracheingaben nicht mehr nur mit Links, sondern mit strukturierten KI-Antworten reagiert. Die klassischen zehn blauen Links treten zunehmend in den Hintergrund – zugunsten von interaktiven, visuell aufbereiteten Ergebnissen.

Sobald der AI Mode aktiviert ist, erscheint oberhalb der gewohnten Suchergebnisse ein generatives Antwortfeld. Dort werden Themen kurz zusammengefasst, Produktempfehlungen integriert, weiterführende Fragen vorgeschlagen oder auch Handlungsoptionen wie Checklisten angezeigt. Nutzer können direkt im Antwortfeld weiterfragen – ein echter Paradigmenwechsel weg von der Einzelsuche hin zur Such-Interaktion.

Besonders im Fokus stehen komplexe Suchanfragen, für die es keine einfache Antwort gibt: Anleitungen, Vergleiche, Planungshilfen oder erste Ideen bei offenen Fragen. Hier spielt der AI Mode seine Stärken aus und bietet eine „Erstberatung“, bevor man sich in tiefere Inhalte klickt.

Google betont, dass alle generierten Inhalte auf zuverlässigen Quellen basieren und stets mit klassischen Suchergebnissen und Links unterlegt sind. Dennoch ist klar: Die Rolle von Webseiten als reine Informationslieferanten wird sich verändern – sie müssen künftig stärker durch Qualität, Tiefe und thematische Relevanz überzeugen, um von der KI zitiert oder eingebunden zu werden.

Quelle: Google Blog

Google gibt Tipps, um im AI Mode sichtbarer zu sein

Mit der Einführung des „AI Mode” stellt sich vielen Websitebetreibern und SEOs die zentrale Frage: „Wie kann ich sicherstellen, dass meine Inhalte in den KI-generierten Antworten auftauchen?” Google hat hierzu erstmals konkrete Empfehlungen veröffentlicht, wie sich Inhalte für die KI optimieren lassen.

Im Fokus stehen dabei vor allem inhaltliche Klarheit, strukturelle Ordnung und vertrauenswürdige Informationen. Inhalte sollten präzise Fragen beantworten, gut gegliedert sein und möglichst direkt auf die Suchintention eingehen. Besonders wichtig sind Transparenz, Quellenangaben und Expertise. Google betont, dass Inhalte mit klarem Autorenschaftsnachweis, redaktioneller Verantwortung und fachlicher Tiefe bevorzugt werden – ganz im Sinne des bewährten E-E-A-T-Prinzips.

Technisch rät Google dazu, strukturierte Daten sinnvoll zu nutzen und Inhalte so aufzubereiten, dass sie für die KI leicht erfassbar und verlässlich zitierbar sind. Auch eine optimierte interne Verlinkung kann dabei helfen, dem System Kontext zu geben und Inhalte besser einzuordnen.

Zudem macht Google deutlich: Es geht nicht darum, „für die KI zu schreiben“, sondern dem Nutzer echten Mehrwert zu bieten – die KI ist lediglich das Vermittlungsmedium. Inhalte, die verständlich, hilfreich und relevant sind, haben die besten Chancen, im AI Mode prominent platziert zu werden.

Quelle: Google Developers

Search Console bekommt doch kein Update mit Reporting für den AI Mode

Für kurze Zeit keimte Hoffnung auf, dass Google die Leistungsdaten des neuen AI Mode separat in der Search Console ausweisen würde. Aussagen aus dem Unternehmen ließen vermuten, dass ein eigenes Reporting kurz vor dem Rollout stünde. Inzwischen ist jedoch klar: Eine solche Erweiterung wird es nicht geben. Alle durch AI Overviews erzeugten Impressionen und Klicks werden weiterhin dem allgemeinen Suchtyp „Web“ zugeordnet. Damit bleibt eine präzise Analyse der Performance im AI-Bereich vorerst unmöglich.

Hinzu kommt ein technisches Problem, das insbesondere Datenanalysten Kopfzerbrechen bereitet: Ein Bug sorgt derzeit dafür, dass Referrer-Informationen bei Klicks auf Links in den AI Overviews nicht korrekt übermittelt werden. Grund ist eine fehlerhafte Handhabung des noreferrer-Attributs im Chrome-Browser. Das Resultat: Besuchsdaten können verloren gehen oder falsch zugeordnet werden – ein Risiko für alle, die auf exakte Traffic-Auswertungen angewiesen sind.

Auch wenn KI-Funktionen das Sucherlebnis zunehmend prägen, zeigt sich an diesem Beispiel, dass es im Hintergrund noch an verlässlichen Strukturen für Analyse und Kontrolle mangelt.

Im Developer-Bereich der Search Console wird unter „KI-Funktion“ die Auswertung wie folgt beschrieben:

Genau wie der Rest der Suchergebnisseite werden Websites, die in KI-Funktionen wie Übersichten mit KI und KI-Modus erscheinen, in der Search Console in den gesamten Suchtraffic einbezogen. Insbesondere werden sie im Leistungsbericht im Suchtyp „Web“ erfasst.

Bezüglich der KI-Übersichten findet ihr folgenden Vermerk:

Für die Protokollierung in der Search Console werden Links, die in der Übersicht mit KI erscheinen, auf die im Leistungsbericht für Suchergebnisse aufgeführten Gesamtzahlen angerechnet.

Quellen: John Mueller LinkedIn, Google Developers, SEO Roundtable

Keine wichtigen News mehr verpassen

Dank aktuellen Infos der Konkurrenz voraus: Abonniere noch heute unseren kostenlosen Fachexpertenblog und bleib immer up to date

Bleib immer up to date – mit njoy

Du möchtest auch in 2025 keine wichtigen News aus der Welt der Suchmaschinenoptimierung verpassen? Dann abonniere unseren Newsletter und erfahre direkt, sobald wir einen neuen Fachexpertenblog oder SEO-Monatsrückblick veröffentlicht haben – wir freuen uns auf dich!

Dir ist unser Blog nicht genug? Dann schau gerne auf unseren Social-Media-Kanälen vorbei. Auch hier warten weitere spannende Nachrichten aus der Welt des Online Marketings auf dich!

Mach jetzt den ersten Schritt

Nutze unser Kontaktformular

…oder kontaktiere uns direkt!

Deine Ansprechpartnerin

Wir sind für dich da

Montag – Freitag

von 9:00 bis 18:00 Uhr

Anschrift

Hohenstaufenring 62

50674 Köln